Рядовая ситуация: вы заходите в приложение банка, и умная программа помогает вам получить ответ на вопрос. Например, каков лимит переводов по карте. Или какие кредитные программы у финансовой организации наиболее выгодные. Удобно? Безусловно. Но, увы, и в этой бочке меда есть своя ложка дегтя.

Кто такие боты и где они живут

Дословно «бот» – это сокращения от английского robot. То есть, программа, которая способна автоматически выполнять какие-либо действия. Имитируя при этом работу самого человека. Боты прочно начали входить в нашу жизнь, начиная с 1988 года, на заре развития телекоммуникационных технологий. Именно тогда потребовалось разработать хитрый механизм, чтобы чаты всегда оставались открытыми, даже если их покинет пользователь. Тогда и появились роботы-помощники, «дежурящие в группах». Тогда они просто создавали иллюзию активности.

Сегодня функция ботов явно вышла за рамки рядовых задач и передачи базовых сообщений. Эти программы быстро «социализировались» и стали частью глобальной архитектуры интернета – средством взаимодействия пользователей с Сетью, принципиально новым информационным продуктом.

А что внутри?

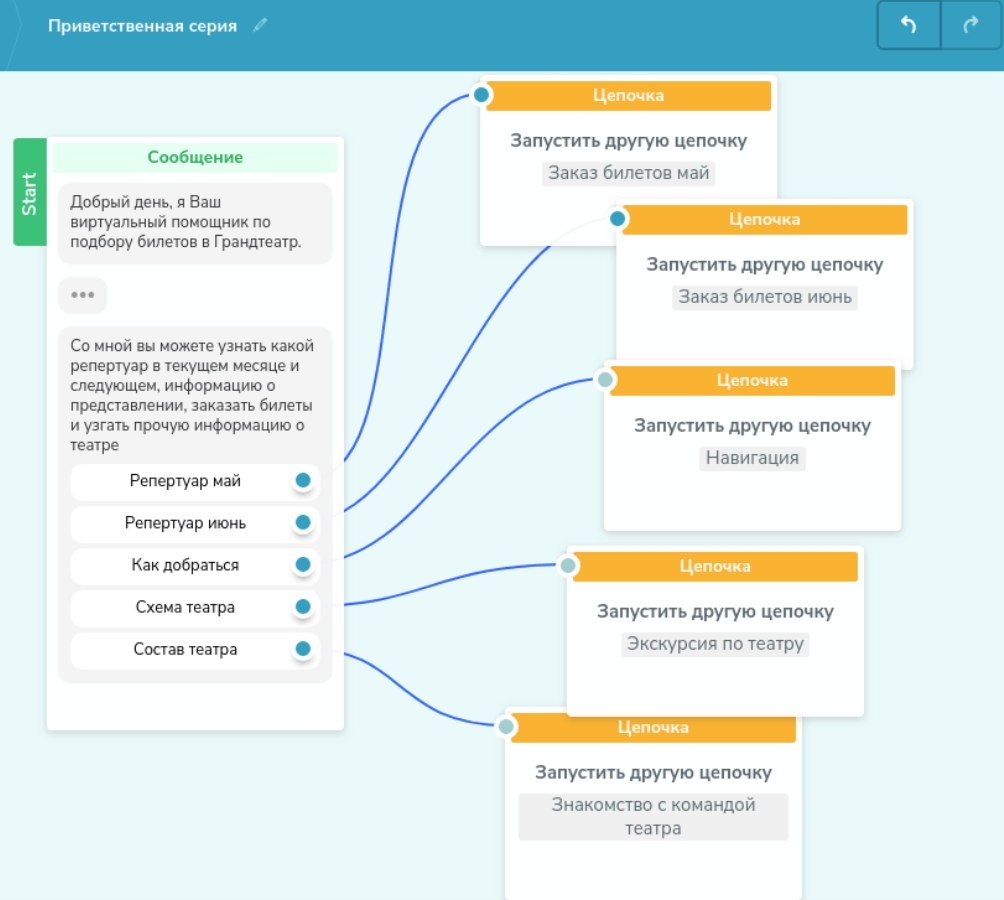

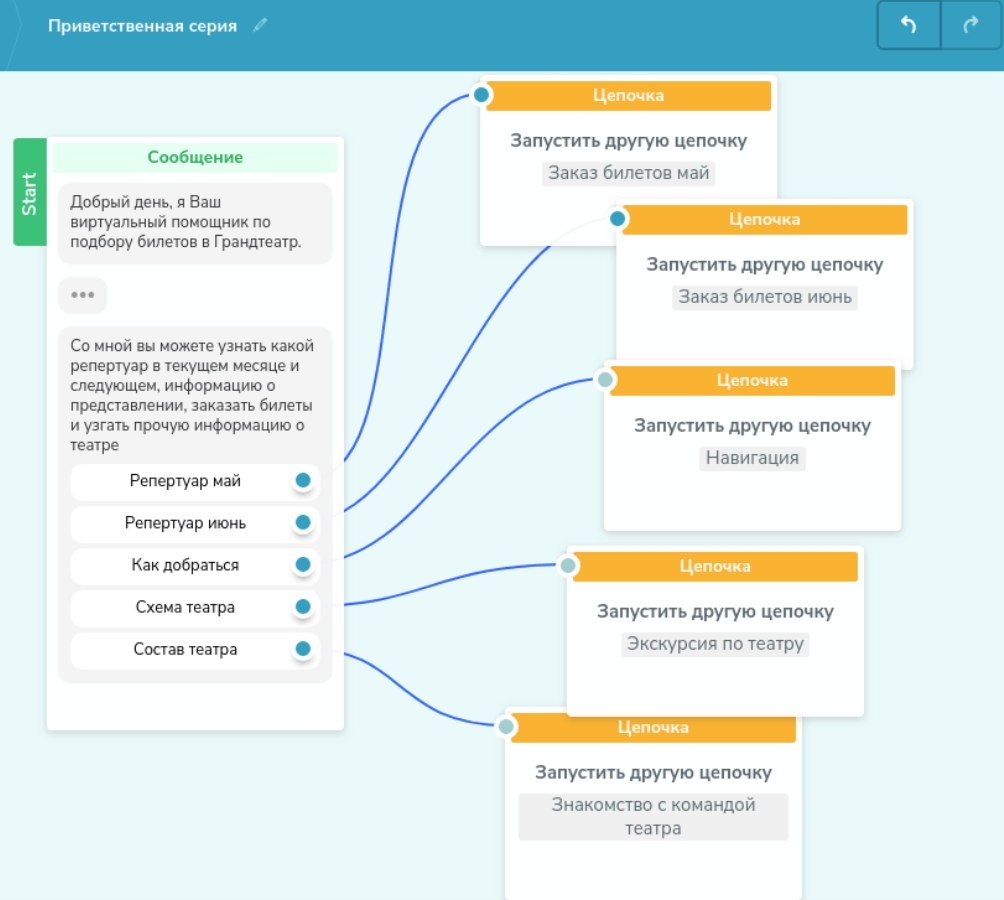

Боты – совокупность набора алгоритмов, которые помогают им решать задачи. Это может быть не только общение с человеком (или имитация такого общения), но и сбор данных с других сайтов. Все уже привыкли к чат-ботам. Этот умный помощник предоставляет пользователю подсказки и ответы на вопросы. Чат-боты используются в различных областях – от обслуживания клиентов до изучения иностранных языков. Именно чат-бот на основе технологии GPT внедрят в работу портала «Госуслуг». Нейросетью дополнять функционал уже известного помощника – робота Макса.

Социальные боты

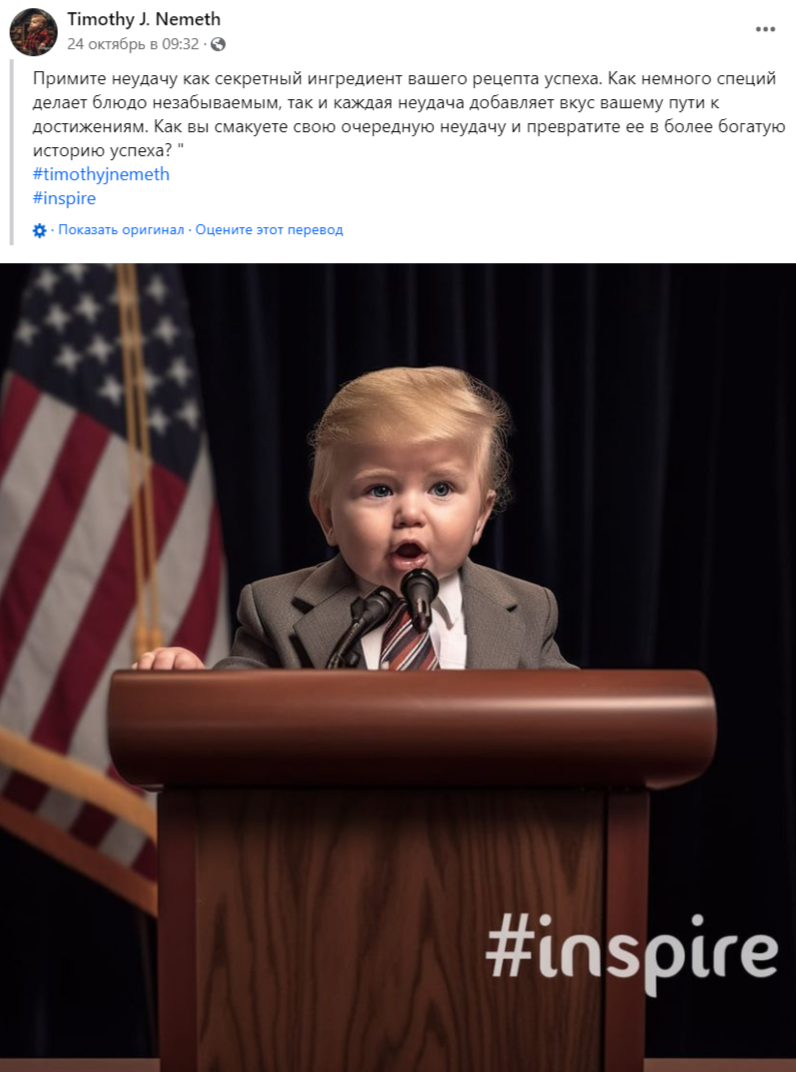

Именно они используются в социальных сетях. Служат для автоматического написания сообщений, играют роль мнимых подписчиков (для увеличения аудитории, которого на самом деле нет). Вывести таких «подписчиков» на чистую воду иногда бывает довольно проблематично, потому что они мастерски прикидываются уникальными пользователями.

Скраперы

Эти боты делают автоматическими многие процессы в интернете (другое их название – вэб-боты). Анализируют сайты, извлекают необходимые данные для их дальнейшей обработки. Например, специалисты по маркетплейсам используют такие программы для оценки маржинальности продуктов и разработки торговых стратегий.

«Интеллектуальные боты»

Эти боты созданы на основе искусственного интеллекта, они обладают способностью к самообучению. Могут самостоятельно принимать решения и совершенствовать алгоритмы в процессе работы с пользователем.

Благо или зло?

В век информационных технологий, роботов и искусственного интеллекта напрасно отрицать, что боты будут играть все более заметную роль. Например, бизнес станет активнее использовать их для освоения новых рынков и более качественного обслуживания клиентов. То же самое можно сказать и о социальных сетях и мессенджерах. И вот здесь таится главная опасность.

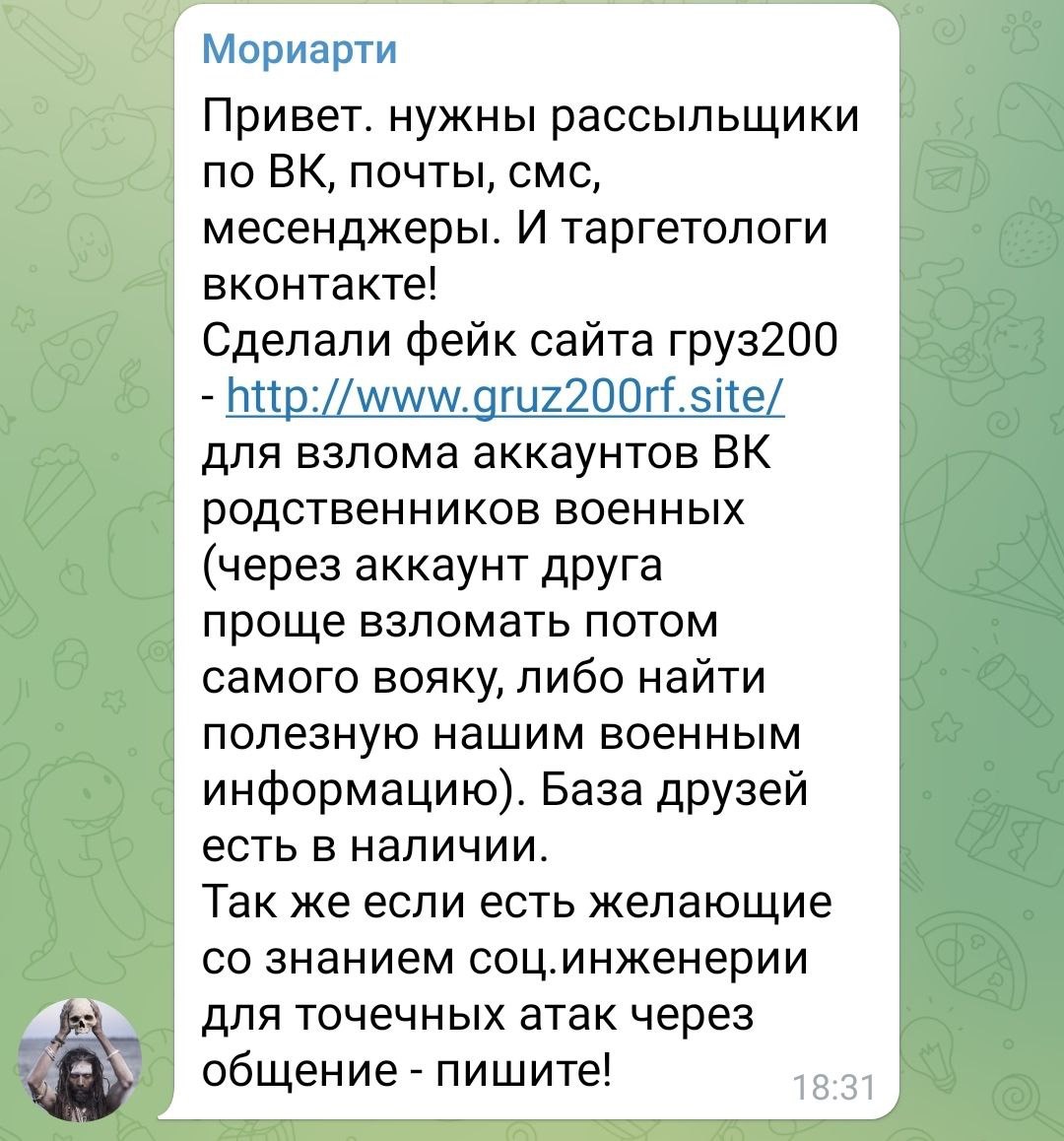

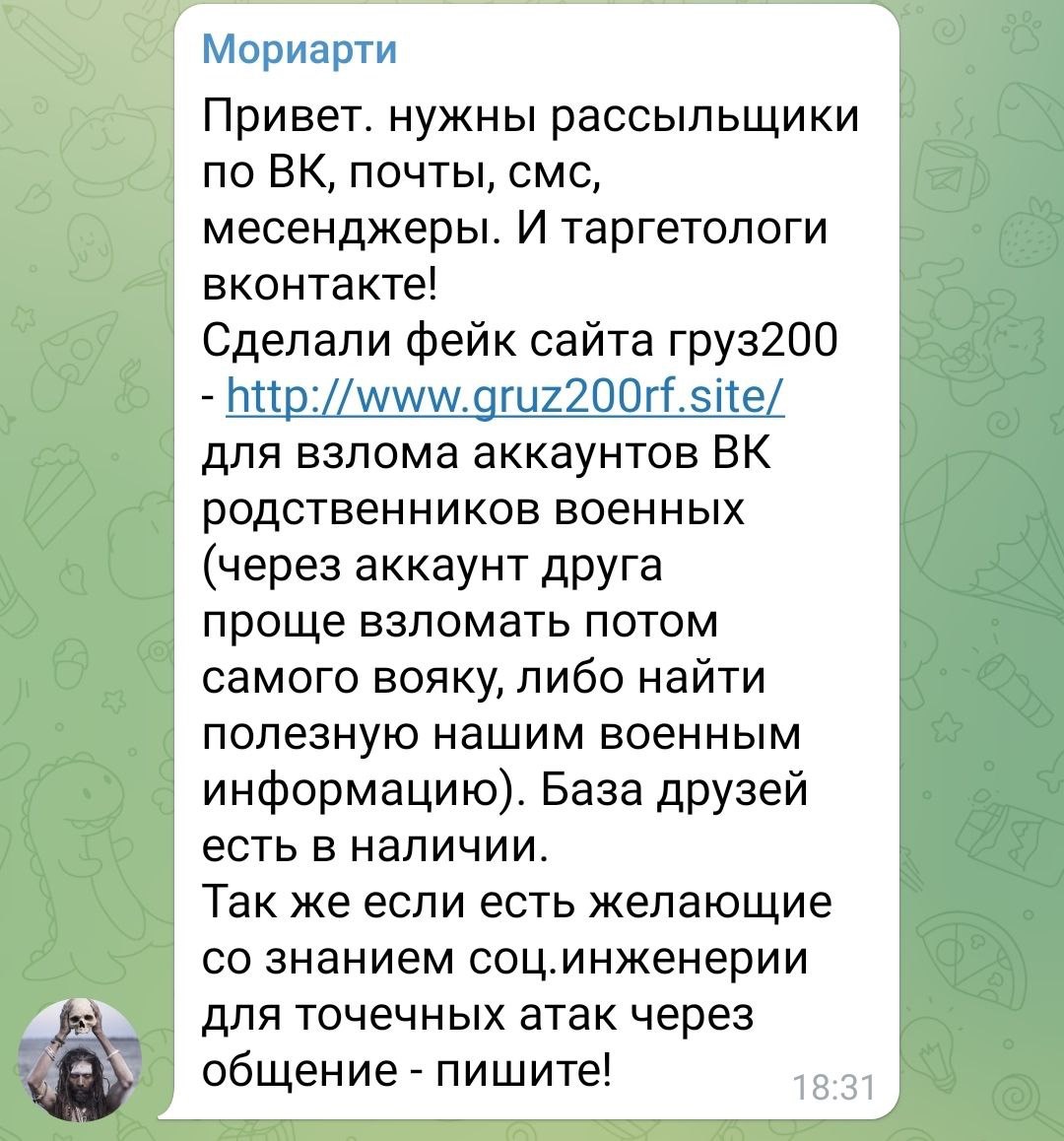

Например, в телеграме помимо ботов, предназначенных для запуска публикаций, есть и другие. Откровенно мошеннические и криминальные. Явно следует насторожиться, если электронный «друг» требует предоставить конфиденциальную информацию: данные паспорта или банковских карт. Схемы обмана с использованием телеграм-ботов довольно распространены. Пользователям могут присылать фейковые сообщения о взломе аккаунта. И даже шантажировать!

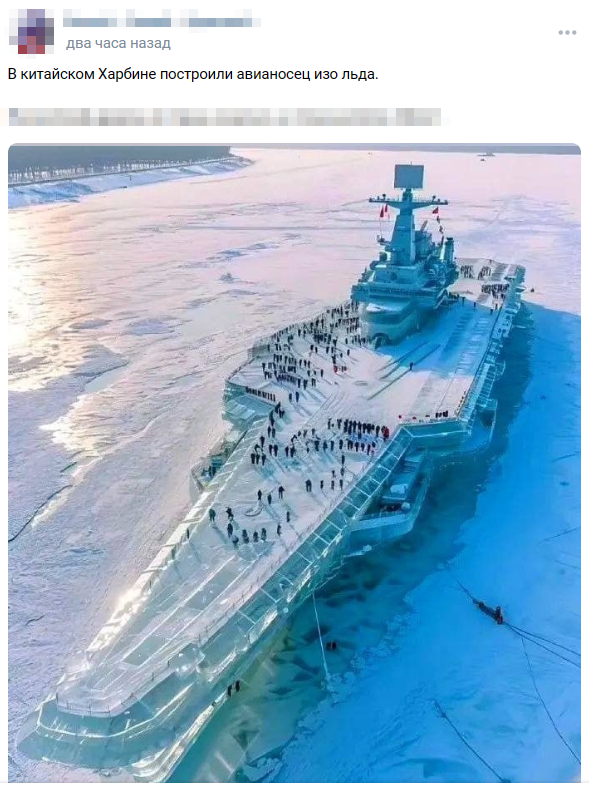

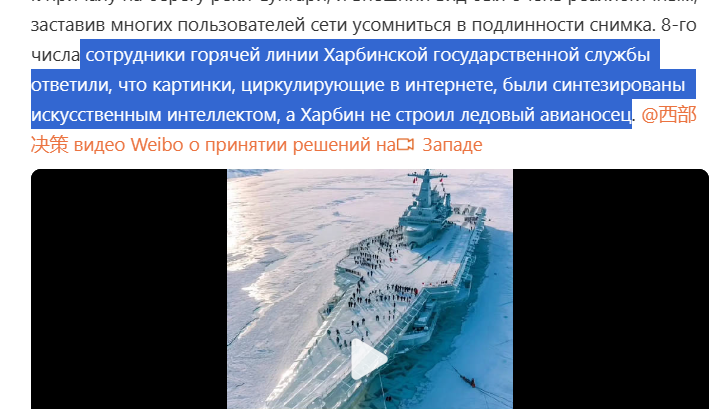

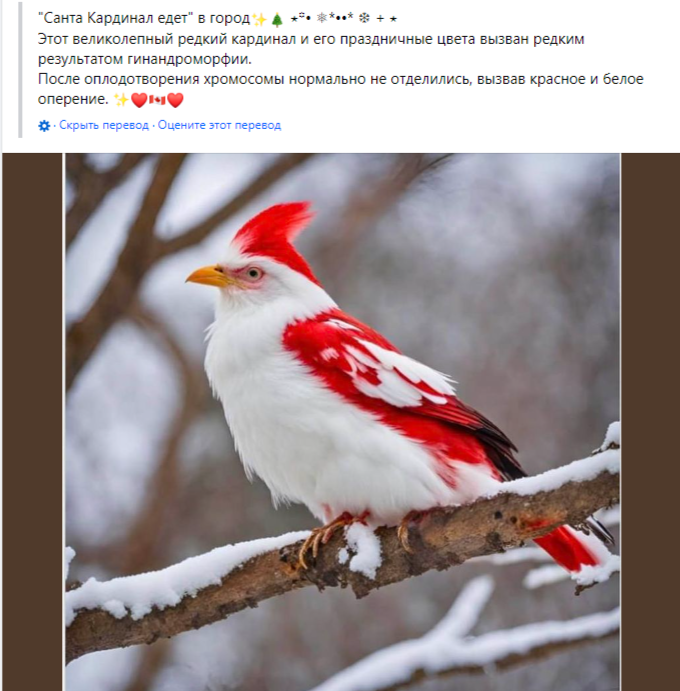

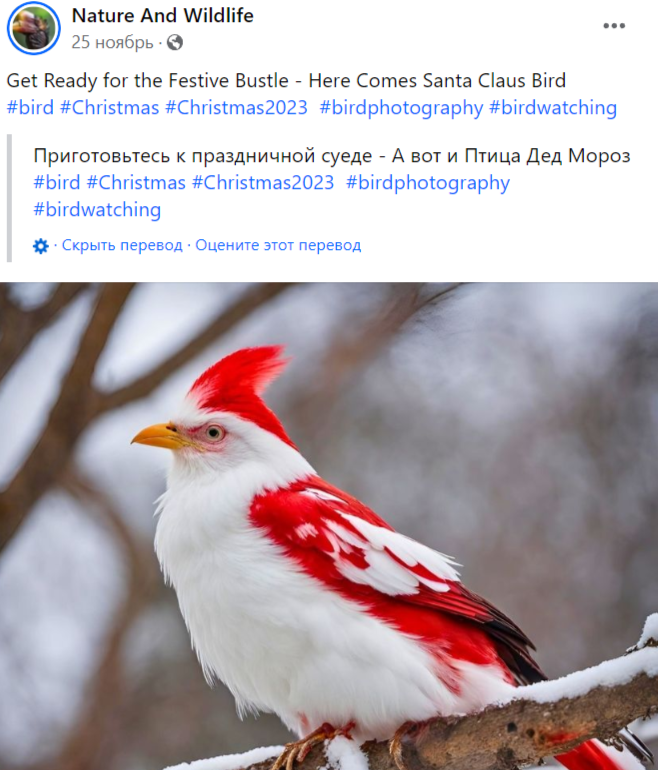

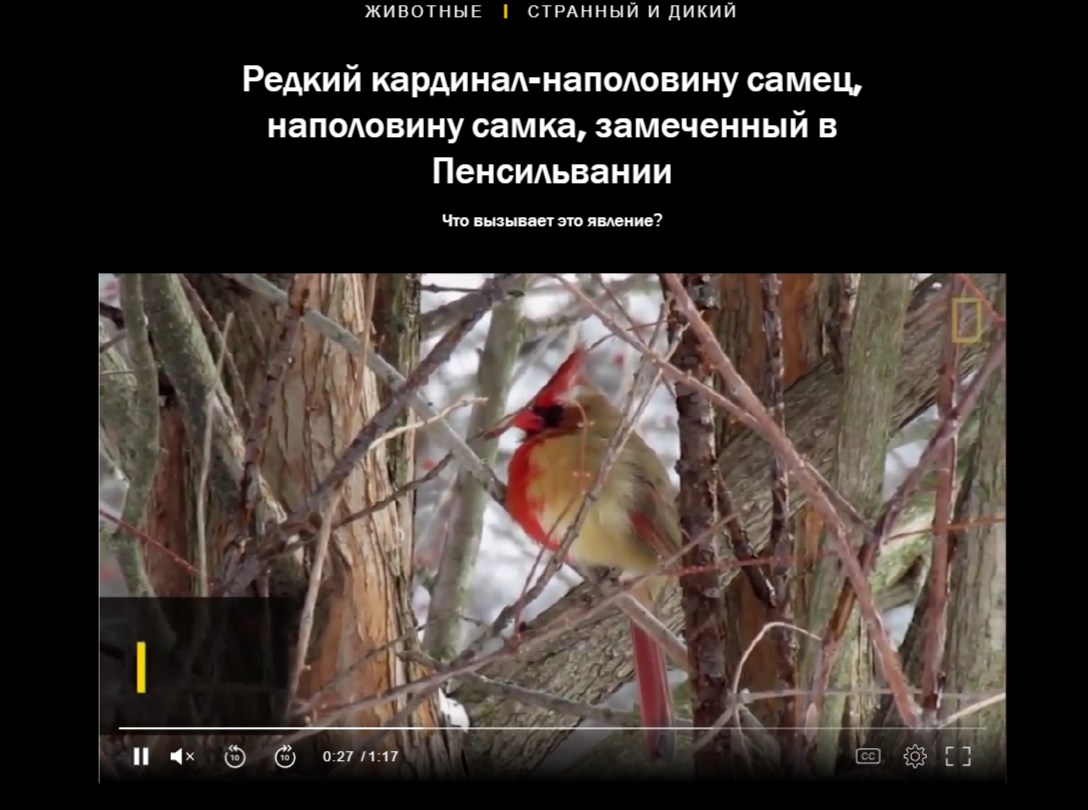

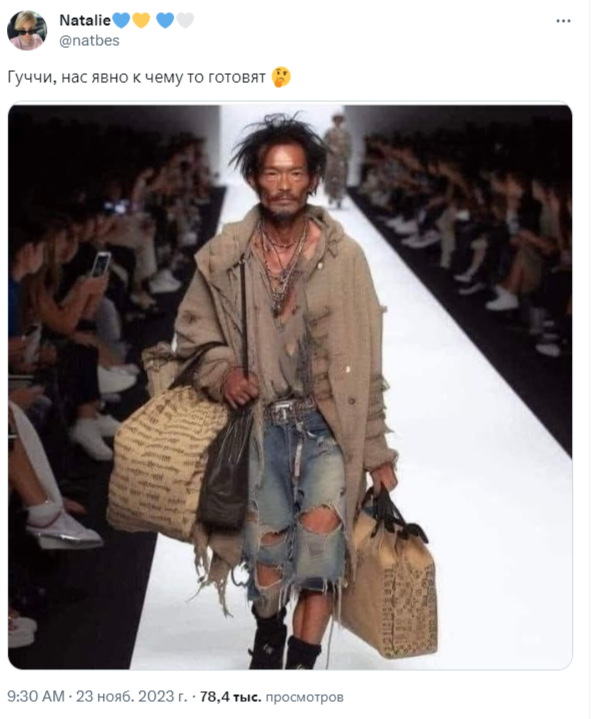

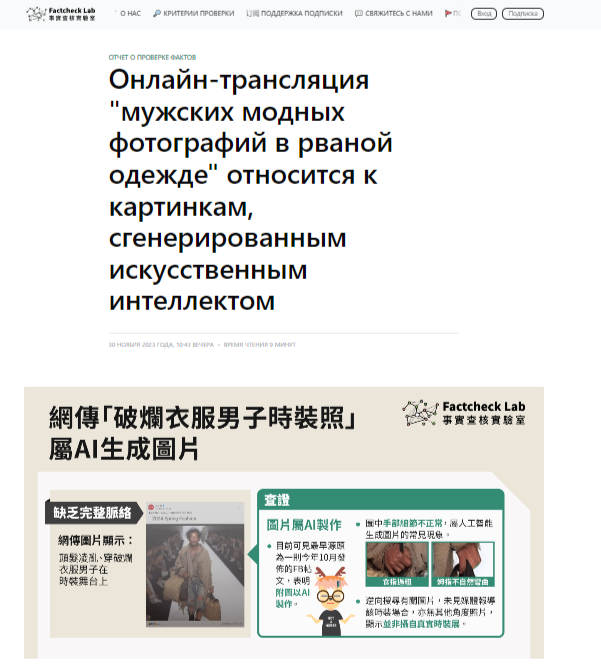

Нередки случаи, когда боты используются в информационных войнах. Например, с помощью них создаются поддельные профили в социальных сетях. Они могут имитировать релевантных пользователей для распространения лживой информации. За примерами далеко ходить не нужно – в телеграме есть немало аккаунтов, которые ведут якобы лидеры общественного мнения. При проверке это оказывается делом рук украинских спецслужб (ЦИПСО) и так называемых креоферм. С использованием ботов и поддельных аккаунтов можно манипулировать комментарийной активностью в социальных сетях. Киберпропаганда легко может быть использована для управления общественным мнением.

Кто виноват и что делать?

Конечно, социальные сети и специалисты по информационной безопасности регулярно работают над выявлением и предотвращением манипуляций. Но и сам пользователь должен обладать навыками элементарного фактчекинга:

- Внимательно смотреть на ссылки, прежде чем по ним переходить. Фишинговые ссылки имеют странные доменные имена, мимикрирующие под известные информационные ресурсы;

- Запрашивание конфиденциальной информации – табу! Если этим занимается бот, перед вами не электронный друг, а враг;

- Если перед вами заманчивое предложение купить доступ к «секретным практикам» или заведомо незаконные услуги (например, чудо-справка, дающая 100% гарантии отсрочки от военной службы) – перед вами самые настоящие мошенники.

Не поддавайтесь манипуляциям! Лучшая защита от киберпреступников – холодная голова.

Читайте также

Хотите опубликовать свой разбор на сайте «Лапша Медиа»? Как это сделать — подробно рассказываем здесь.